Bagaimana saya dapat men-download seluruh situs web?

Bagaimana saya dapat men-download semua halaman dari sebuah situs web?

Platform apapun baik-baik saja.

H karya-karya seperti juara untuk menyalin isi dari seluruh situs. Alat ini bahkan dapat mengambil potongan-potongan yang diperlukan untuk membuat sebuah situs web dengan active code konten bekerja secara offline. Saya kagum pada hal-hal yang dapat mereplikasi offline.

Program ini akan melakukan semua yang anda butuhkan itu.

Selamat berburu!

Wget adalah klasik alat baris perintah untuk tugas semacam ini. Datang dengan sebagian besar sistem Unix/Linux, dan anda bisa mendapatkannya Windows juga. Pada Mac, Homebrew adalah cara termudah untuk menginstal (brew install wget).

Anda'd melakukan sesuatu seperti:

wget -r --no-parent http://site.com/songs/Untuk lebih jelasnya, lihat Wget Manual dan contoh, atau misalnya ini:

Menggunakan wget:

wget -m -p -E -k www.example.comOpsi menjelaskan:

-m, --mirror Turns on recursion and time-stamping, sets infinite

recursion depth, and keeps FTP directory listings.

-p, --page-requisites Get all images, etc. needed to display HTML page.

-E, --adjust-extension Save HTML/CSS files with .html/.css extensions.

-k, --convert-links Make links in downloaded HTML point to local files.Internet Download Manager memiliki sebuah Situs Grabber utilitas dengan banyak pilihan yang memungkinkan anda benar-benar men-download setiap website yang anda inginkan, dengan cara yang anda inginkan.

-

Anda dapat menetapkan batas pada ukuran halaman/file untuk download

-

Anda dapat mengatur jumlah cabang untuk mengunjungi situs

-

Anda dapat mengubah cara script/popup/duplikat berperilaku

-

Anda dapat menentukan domain, hanya di bawah domain semua halaman/file yang memenuhi pengaturan yang diperlukan akan di-download

-

Link yang dapat dikonversi ke offline link untuk browsing

-

Anda memiliki template yang memungkinkan anda memilih pengaturan di atas untuk anda

Software ini tidak gratis namun - melihat apakah itu sesuai dengan kebutuhan anda, gunakan versi evaluasi.

I'll alamat online buffering bahwa browser menggunakan...

Biasanya kebanyakan browser menggunakan browsing cache untuk menyimpan file yang anda download dari situs web ini, sehingga anda tidak perlu men-download gambar statis dan konten yang lebih dan lebih lagi. Hal ini dapat mempercepat hal-hal yang sedikit di bawah beberapa keadaan. Secara umum, kebanyakan browser cache yang terbatas untuk ukuran tetap dan ketika itu adalah yang membatasi, itu akan menghapus file yang tertua di cache.

Isp cenderung memiliki caching server yang menyimpan salinan dari situs-situs yang biasa diakses seperti ESPN dan CNN. Ini menghemat kesulitan memukul situs ini setiap kali seseorang pada jaringan mereka pergi ke sana. Hal ini dapat jumlah penghematan yang signifikan dalam jumlah yang digandakan permintaan ke situs eksternal ke ISP.

Aku belum pernah melakukan ini bertahun-tahun, tapi masih ada beberapa keperluan di luar sana. Anda mungkin ingin mencoba Web Ular. Saya percaya saya digunakan bertahun-tahun yang lalu. Aku ingat nama saat saya membaca pertanyaan anda.

Saya setuju dengan Stecy. Jangan palu situs mereka. Sangat Buruk.

Mencoba BackStreet Browser.

ini adalah gratis, kuat secara offline browser. Kecepatan tinggi, multi-threading situs download dan melihat program. Dengan membuat beberapa simultan permintaan server, BackStreet Browser dapat dengan cepat men-download seluruh situs atau bagian dari situs, termasuk HTML, grafis, Java Applet, suara dan lain pengguna didefinisikan file, dan menyimpan semua file anda hard drive, baik dalam format asli mereka, atau sebagai file ZIP terkompresi dan melihat secara offline.

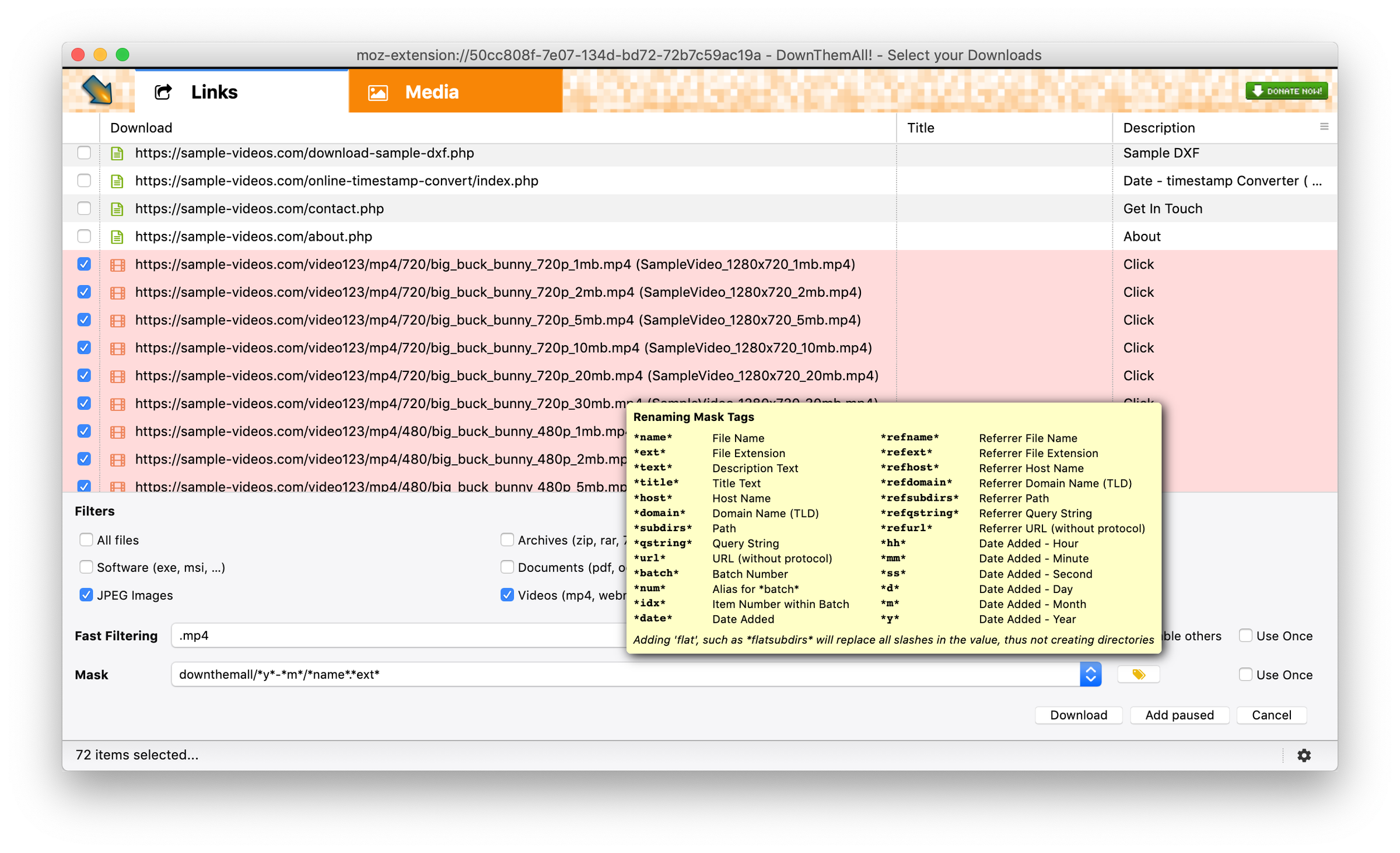

DownThemAll adalah Firefox add-on yang akan men-download semua konten (audio atau file video, misalnya) untuk halaman web tertentu dalam satu klik. Ini doesn't men-download seluruh situs, tapi ini mungkin hal semacam pertanyaan yang sedang mencari.

Untuk Linux dan OS X: saya menulis ambil-situs untuk pengarsipan seluruh situs web WARC file. Ini WARC file dapat browse atau diekstrak. ambil-situs memungkinkan anda mengontrol Url untuk melewatkan menggunakan ekspresi reguler, dan ini dapat berubah ketika merangkak berjalan. Hal ini juga dilengkapi dengan aplikasi yang luas set default untuk mengabaikan Url sampah.

Ada web dashboard untuk monitoring merangkak, serta tambahan pilihan untuk melewatkan konten video atau tanggapan atas ukuran tertentu.

Daya wget

Sementara wget sudah disebutkan ini sumber daya dan baris perintah yang begitu mulus saya pikir itu layak menyebutkan:

wget -P /path/ke/tujuan/direktori/ -mpck --user-agent="" -e robot=off-tunggu 1 -E https://www.example.com/

Save Page KAMI

Setiap extension untuk Chrome dan Firefox yang download paling/semua halaman web's konten dan menyimpannya langsung ke .html file.

Saya melihat bahwa di sebuah galeri gambar halaman saya mencobanya, itu disimpan thumbnail tetapi tidak penuh gambar. Atau mungkin hanya tidak JavaScript untuk membuka penuh gambar thumbnail.

Tapi, ini bekerja lebih baik dari wget, PDF, dll. Besar solusi sederhana bagi kebanyakan orang's kebutuhan.

Yang terhormat FreeDownloadManager.org memiliki fitur ini juga.

Free Download Manager memiliki itu dalam dua bentuk dalam dua bentuk: Site Explorer dan Situs Spider:

Site Explorer

Site Explorer memungkinkan anda melihat struktur folder dari situs web dan dengan mudah men-download file yang diperlukan atau folder.

HTML laba-Laba

Anda dapat men-download seluruh halaman web atau bahkan seluruh situs web dengan HTML laba-Laba. Alat ini dapat disesuaikan untuk men-download file dengan yang ditentukan ekstensi saja.

Saya menemukan Site Explorer ini berguna untuk melihat folder yang akan sertakan/kecualikan sebelum anda mencoba mencoba untuk men-download seluruh situs - terutama ketika ada seluruh forum bersembunyi di situs yang anda don't ingin download untuk contoh.

Anda dapat menggunakan berikut online gratis alat-alat yang akan membuat file zip dari semua isi yang disertakan dalam url