Hoe kan ik een hele website downloaden?

Hoe kan ik alle pagina's van een website downloaden?

Elk platform is goed.

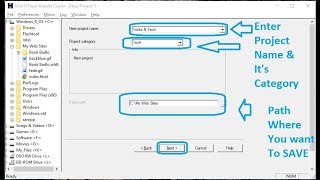

HTTRACK werkt als een kampioen voor het kopiëren van de inhoud van een hele site. Deze tool kan zelfs de stukken pakken die nodig zijn om een website met actieve code inhoud offline te laten werken. Ik sta versteld van de dingen die het offline kan repliceren.

Dit programma zal alles doen wat je van hem verlangt.

Goede jacht!

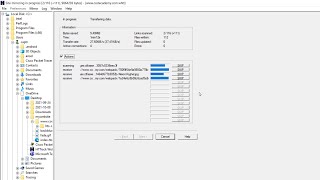

Wget is een klassiek command-line gereedschap voor dit soort taken. Het wordt geleverd bij de meeste Unix/Linux systemen, en je kunt het voor Windows ook krijgen. Op een Mac is Homebrew de eenvoudigste manier om het te installeren (brew install wget).

U'zou zoiets doen als:

wget -r --no-parent http://site.com/songs/Voor meer details, zie Wget Handleiding en zijn voorbeelden, of b.v. deze:

Ik zal de online buffering aanpakken die browsers gebruiken...

Gewoonlijk gebruiken de meeste browsers een browsing cache om de bestanden die u van een website downloadt een tijdje bij te houden zodat u geen statische beelden en inhoud telkens opnieuw moet downloaden. Dit kan de snelheid onder sommige omstandigheden behoorlijk opvoeren. Over het algemeen zijn de browsercaches beperkt tot een vaste grootte en wanneer die limiet wordt bereikt, worden de oudste bestanden in de cache verwijderd.

ISP's hebben vaak caching-servers die kopieën bewaren van websites die vaak worden bezocht, zoals ESPN en CNN. Dit bespaart hen de moeite om deze sites te bezoeken telkens wanneer iemand op hun netwerk er naartoe gaat. Dit kan een aanzienlijke besparing opleveren van het aantal dubbele verzoeken aan de ISP om externe sites te bezoeken.

![[Hindi]How To Download Complete Website For Offline Use || Website ko download kaise kare ?](https://img.youtube.com/vi/-JXq74Uzy7I/mqdefault.jpg)

![How to copy and download complete front end design of any website [Easy method] ☑️](https://img.youtube.com/vi/Um6oTbKO530/mqdefault.jpg)